我們每天使用的 AI 系統藏著一個秘密

一間中國 AI 實驗室如何解決一個你從未聽過的難題,以及這對人工智慧的未來有何意義

當你請 ChatGPT 寫一封電子郵件、讓 Claude 幫你腦力激盪,或用 AI 生成一張圖片時,你正在與研究人員所稱的「大型語言模型」互動。這類 AI 系統內含數十億個微小的數學運算,共同協作完成任務。

但多數人沒意識到的是:打造這些 AI 系統極其困難,而且原因可能出乎你意料。

挑戰不只在於擁有足夠的電腦或蒐集足夠的資料。有個更根本的問題困擾 AI 研究人員多年:你要怎麼教導一個有數十億個活動零件的系統,同時不讓整個系統崩潰?

中國頂尖 AI 實驗室 DeepSeek 的研究團隊最近發表了一項突破,解決了這道難題的一部分。他們的研究聽起來很技術性(稱為「流形約束超連接」),但核心概念其實出奇直觀,而且呈現了 AI 系統究竟如何學習的迷人之處。

傳話遊戲的難題

要理解 DeepSeek 解決了什麼問題,請想像你和 100 個人排成一列玩傳話遊戲。

在經典的傳話遊戲中,你對第一個人耳語一則訊息,他再傳給下一個人,依此類推。等訊息傳到第 100 個人時,通常已經完全走樣了。小錯誤在每一步不斷累積,最終原意盡失。

這正是 AI 系統在訓練過程中發生的情況。

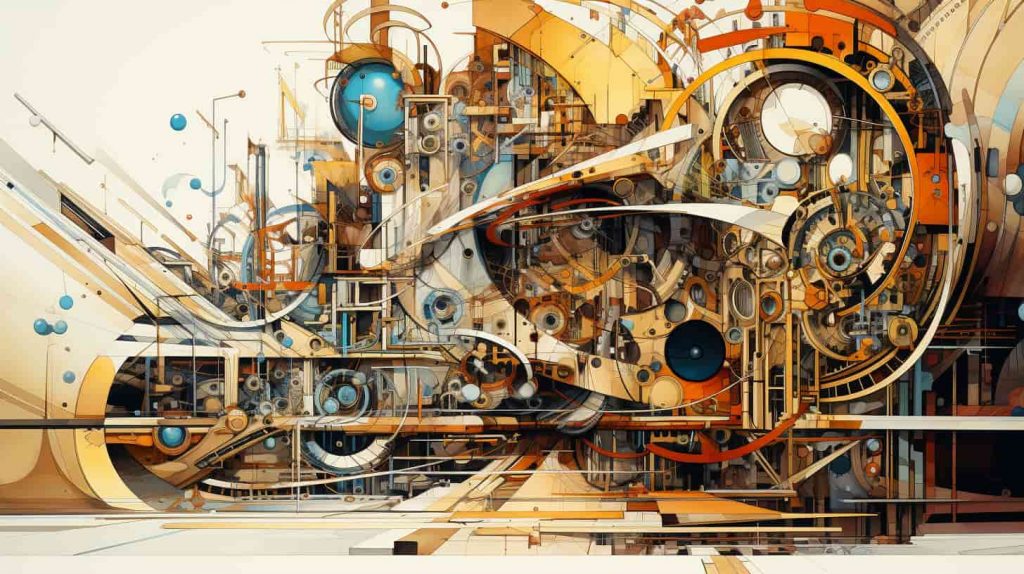

現代 AI 模型由多層結構組成,有時多達 100 層甚至更多。資訊從第一層流向最後一層,每一步都會被轉換。在學習過程中,關於錯誤的回饋會反向流經所有層,幫助每一層改進。

但問題來了:如果訊號在每一層被稍微放大或減弱,經過 100 層之後,它可能變得天文數字般巨大(導致系統「爆炸」),或者微弱到幾乎消失(導致系統「忘記」該學的東西)。

這不是理論上的擔憂。正因如此,數十年來我們無法訓練超過幾層的神經網路。

改變一切的高速公路

2015 年,微軟的研究人員有了一個簡單卻革命性的發現。他們問:如果我們加一條捷徑,讓資訊可以直接從前面的層跳到後面的層呢?

把它想成在高速公路上增設快速車道。不用強迫每輛車都經過每個交流道,而是開闢讓車流直達的路徑。地方道路仍供需要的車輛使用,但快速車道能防止壅塞。

用 AI 術語來說,這叫做「殘差連接」或「跳躍連接」,形式如下:

新輸出 = 舊輸入 + 本層的變化量那個簡單的加號(把原始輸入加回去)帶來了變革性的影響。突然間,你可以訓練 100 層、500 層,甚至 1,000 層的網路了。訊號有了一條受保護的高速公路可走,不受旁邊小路上發生的扭曲影響。

這項技術如今被用於幾乎所有現代 AI 系統,從驅動 ChatGPT 的模型到生成 AI 圖片的系統,無一例外。

雄心勃勃的升級卻適得其反

時間快轉到 2024 年。研究人員開始思考:如果我們能讓這些高速公路變得更好呢?

原本的跳躍連接就像單線道。如果擴展成四線道呢?八線道呢?如果再加上智慧交通控制器,讓它學習引導資訊流的最佳方式呢?

這個構想稱為「超連接」,確實展現了潛力。在小規模實驗中,配備這種增強連接的 AI 模型表現明顯優於標準模型。更豐富的資訊流似乎幫助模型學到更細微的模式。

但有個問題只有在放大規模時才浮現。

當 DeepSeek 嘗試用這項技術訓練一個真正大型的模型(擁有 270 億參數)時,大約在訓練第 12,000 步出了問題。

模型的學習突然變得不穩定。原本應該維持穩定的內部訊號開始劇烈震盪。彷彿那些智慧交通控制器失控了,有時把訊號放大 3,000 倍,而它們本該保持穩定才對。

這項原本要讓 AI 更上層樓的升級,反而讓訓練變得不可能。

在混亂中找到秩序

這就是 DeepSeek 的洞見發揮作用之處,而且這個解法優雅極了。

超連接中「智慧交通控制器」的問題在於它們太自由了。它們可以學會放大訊號、減弱訊號,或以任何方式混合訊號。經過 100 多層,這些微小偏差累積成了混亂。

DeepSeek 的解法是約束交通控制器能做的事情。

想像你正在設計汽車在高速公路車道間移動的規則。與其允許任何移動方式,你設定一個特定約束:所有車道的車輛總數必須維持不變。車子可以換車道,但不能憑空增加或消失。

在數學上,DeepSeek 使用「雙隨機矩陣」來達成這點。這個術語聽起來很花俏,意思是轉換規則必須讓一切保持平衡。輸入 100 單位的訊號,就會輸出 100 單位。訊號可以重新分配、重新排列、重新混合,但絕不會被放大或減弱。

這個約束有個了不起的特性:無論你疊加多少層,累積問題都會消失。即使經過 100 層轉換,總訊號量依然穩定,因為每一層都被要求保持守恆。

這就像確保傳話遊戲中每個玩家必須傳遞與收到完全相同數量的詞,他們可以重新排列,但不能增減任何一個詞。突然間,遊戲變得可靠多了。

成果不言自明

差異十分顯著。

使用原本的超連接方法:

- 訓練在第 12,000 步左右變得不穩定

- 內部訊號被放大高達 3,000 倍

- 模型無法發揮全部潛力

使用 DeepSeek 的約束方法(稱為「mHC」,即流形約束超連接):

- 訓練全程保持穩定

- 訊號放大率維持在接近 1 倍(意即沒有扭曲)

- 模型在推理測試、問答及其他評測上都取得更好的成績

在一項邏輯推理測試中,約束方法得分 51.0%,標準模型則為 43.8%,這是 AI 能力上相當有意義的提升。

更重要的是,這種穩定性幾乎不需額外代價。所需的額外運算量僅比標準方法多約 6.7%。以它帶來的穩定性與效能提升來看,這是非常划算的取捨。

為什麼這對你明天使用的 AI 很重要

你可能會想:我為什麼要關心 AI 系統的內部工程?

原因如下:

- 它讓更大、更強的 AI 成為可能:我們今天使用的 AI 系統不只受限於運算能力,也受限於我們能否穩定地訓練它們。像 mHC 這樣的突破拓展了可能性的疆界,有望讓 AI 系統進行更深入的推理、更好地理解脈絡,並減少犯錯。

- 它顯示我們仍在學習如何打造 AI:儘管外界炒作不斷,AI 仍是一個年輕的領域。我們並不完全理解這些系統為何有效,也不知道如何可靠地改進它們。這類研究揭開了依然存在的真實挑戰,以及研究人員正在發現的創意解方。

- 它展示了約束的重要性:這裡有個反直覺的啟示:有時候,限制一個系統能做的事,反而讓它更強大。藉由防止 AI 內部訊號失控,DeepSeek 實際上解放了系統,使其學習得更有效。這呼應了工程與自然界中常見的原則:約束往往是賦能,而非限制。

- 它預示了未來的創新方向:如果擴展 AI 內部的資訊高速公路能帶來更好的效能,還有哪些架構創新是可行的?這項研究為改進 AI 開闢了新方向,不只靠更多資料或更強運算力,而是靠更聰明的系統設計。

更宏觀的視野:AI 是如何打造的

讓我們拉高視角,把這項研究放進 AI 開發的整體脈絡來看。

打造最先進的 AI 系統涉及幾個階段:

- 階段一:架構設計 研究人員決定如何建構 AI 系統,包括多少層、如何連接、執行哪些數學運算。mHC 就是這個階段的創新。

- 階段二:訓練 AI 被餵入龐大的文字(或圖片,或其他資料),學習預測其中的模式。這是運算資源消耗最大的階段,也是 DeepSeek 所解決的那類不穩定問題最關鍵的環節。

- 階段三:微調與安全 訓練好的模型會進一步調校,使其更有幫助、更準確、更安全。這是 AI 公司致力於讓系統適合公眾使用的階段。

- 階段四:部署 模型透過應用程式、API 或消費性產品提供給使用者。

DeepSeek 的貢獻在階段一,但影響會貫穿所有後續階段。更穩定的架構意味著更可靠的訓練,進而造就更好的最終產品。

接下來會如何發展?

DeepSeek 的論文反映出一個日益明確的認知:我們需要更加關注 AI 系統的「宏觀」設計,不只是個別元件,還包括它們如何連接與互動。

其他近期研究也在探索類似的方向:

- 密集連接,讓每一層都能與其他各層溝通

- 記憶矩陣,賦予 AI 系統一種工作記憶

- 動態路由,讓 AI 即時決定資訊該如何流動

這些方法都面臨 mHC 所解決的同一個根本挑戰:如何在增加架構複雜度的同時,不引入不穩定性?

DeepSeek 的洞見(數學約束可以賦能而非限制)很可能會影響這個方向的後續研究。

結語

下次你使用 AI 助手,它給你一個深思熟慮、細緻入微的回應時,請記得:幕後有一個極其複雜的系統,資訊在其中流經數百層,每一層都經過精心設計,要在轉換訊號的同時不造成扭曲。

本文描述的突破只是拼圖的一小塊,是針對特定問題的巧妙解方。但它代表了正在穩步提升 AI 系統能力與可靠性的那類工作。

我們仍處於理解如何打造真正智慧系統的早期階段。但隨著每一篇這樣的論文問世,我們就離目標更近一步。靠的不是魔法,而是艱辛、細緻的工程努力。

而這或許是最重要的啟示:那些看似近乎魔法的 AI 系統,實際上是數千名研究人員解決一個個聽起來平凡無奇的問題所累積的成果,例如「我們要怎麼防止訊號在穿越各層時爆炸?」

魔法藏在細節裡。而這些細節正一步步被釐清,一次一個突破。

詞彙表

- 大型語言模型(LLM):一種在海量文字上訓練的 AI 系統,能理解並生成人類語言。例如 GPT-4、Claude 和 Gemini。

- 參數:AI 系統內部可調整的數值,決定系統如何處理資訊。現代 LLM 擁有數十億個參數。

- 層:AI 系統被組織成依序排列的階段,每個階段對資料執行特定轉換。資訊從前面的層流向後面的層。

- 訓練:向 AI 系統展示範例並調整其參數的過程,使其在文字預測等任務上表現更好。

- 殘差連接:一種讓資訊繞過某些層的捷徑,可防止深層網路中的訊號衰減。

- 超連接:殘差連接的增強版,具有多重通道和可學習的路由機制。

- mHC(流形約束超連接):DeepSeek 的創新技術,為超連接加入數學約束以確保穩定性。

- 雙隨機矩陣:一種所有列與行的總和皆為 1 的數學結構,確保轉換過程中總訊號量守恆。

本文根據 DeepSeek-AI 研究人員於 2025 年 12 月發表的研究論文《mHC: Manifold-Constrained Hyper-Connections》撰寫。該論文可於 arXiv 公開取得。