關於 OpenAI 的 Deep Research

OpenAI 在 2025 年 2 月推出的「深度研究」功能,是一個重大的技術突破。這個系統能在 30 分鐘內完成需要人類花費數小時的研究工作。它建立在最新的 o3 模型上,具備動態推理和跨模態分析能力。系統可以自動瀏覽網路、分析資料,並產生完整的研究報告。值得注意的是,它的引證準確率達到 92%,比以前的模型提升了 37%。這項技術預計會重新定義專業研究的範圍,為知識工作帶來革命性的改變。

OpenAI 在 2025 年 2 月推出的「深度研究」功能,是一個重大的技術突破。這個系統能在 30 分鐘內完成需要人類花費數小時的研究工作。它建立在最新的 o3 模型上,具備動態推理和跨模態分析能力。系統可以自動瀏覽網路、分析資料,並產生完整的研究報告。值得注意的是,它的引證準確率達到 92%,比以前的模型提升了 37%。這項技術預計會重新定義專業研究的範圍,為知識工作帶來革命性的改變。

OpenAI 最新發表的 o3-mini 系統規格說明文件,為 AI 安全與效能的平衡樹立了新標竿。這個模型透過思維鏈和審議對齊技術,在回答問題前會先做安全評估,大幅提升了抵抗越獄攻擊的能力。文件詳細說明了多層次的安全測試機制,包括內部評估、紅隊測試和風險分級,同時也展示了 o3-mini 在多語言處理和程式開發等實際應用上的突破。這份完整的技術分析不只說明了目前的成果,也指出了未來發展的方向和挑戰。

如果意識只是演化的一個偶然,而宇宙本身也沒有任何意義的話,那為什麼人類還是那麼執著於追求目的的虛幻呢?明明知道這些目的都是自己想出來的。這是不是就像在對著一個冷漠的虛無空間,演出一場存在主義的戲劇?

這篇文章分享了簡立峰博士在中央研究院的演講,主題是「與 AI 共舞」。他探討了 AI 的快速發展、台灣在 AI 產業中的挑戰與機遇,並強調了資料、算力和硬體的重要性。簡博士也提到台積電的全球影響力,以及台灣應如何在 Edge AI 和應用領域找到突破口,並提醒個人應學會與 AI 互動,提升問問題的能力。

前幾天『NVIDIA』發佈財報之後市值整個暴漲 3,000 億美元,創下美股單日最高市值漲幅。因為本身就打算長期投入人工智慧的領域做深耕,所以多少都有部署些資金在我口中的新時代基建上,我今天就想透過這篇簡短的文章來理清一下為何我認為 NVIDIA 這家公司砸長期上值得我們持續關注,不管你是否要買入,一樣的,我這絕對絕對不是投資建議,大家當做是一篇我如何透過 NVIDIA 去一窺 AI 未來 5~10 年發展可能的一篇筆記文就好。

Sora 是一種由『資料驅動的物理引擎』,其底層是一個端到端的 Diffusion Transformer Model,它可以直接將文字或圖片輸入轉化成影片像素輸出。通過對大量影片數據的梯度下降學習,Sora 在神經網絡的參數中隱性的學習到了一個物理引擎該有的運作方式。

1. Development and Release of Llama 2: 2. Capabilities of Large Language Models (LLMs): 3. Training Methodology of LLMs: 4. Comparison with Other Models: 5.

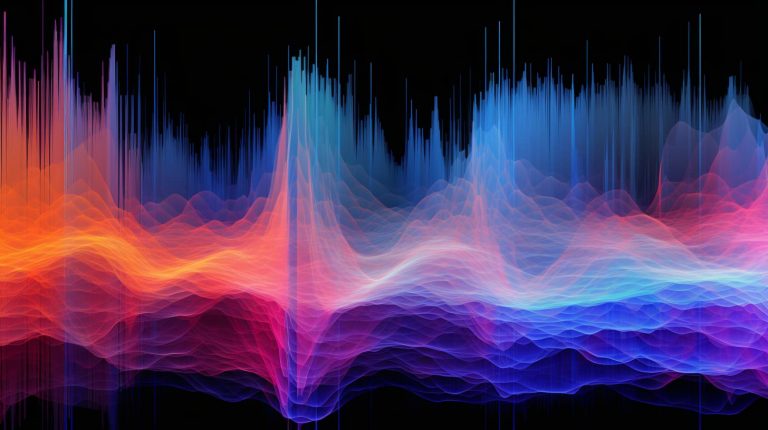

An audio spectrogram provides an intuitive representation of the frequency spectrum of an audio signal as it changes over time. For a segment of audio

Let’s unpack the concept of a “learnable interface layer” step by step, especially in the context of AI, language models, and Transformer architectures: Basic Understanding